KI-Agenten: Teure Fehler und Sicherheitslücken gefährden den Hype

01.05.2026 - 14:21:44 | boerse-global.deDie Versprechen der Tech-Branche für 2026 klingen verlockend: vollautonome KI-Assistenten, die selbstständig komplexe Aufgaben erledigen. Doch die Realität sieht anders aus. Explodierende API-Kosten und kritische Sicherheitslücken bremsen den Enthusiasmus. Branchenanalysten fordern eine grundlegende Neubewertung der Systeme, die ohne menschliche Kontrolle operieren.

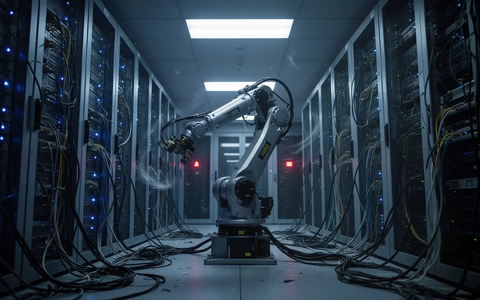

Während viele KI-Projekte derzeit an technischen Hürden scheitern, stehen andere Technologie-Sektoren vor einem massiven Durchbruch. Dieser kostenlose Report enthüllt, wie sich clevere Anleger jetzt bei Cybersecurity und Robotik positionieren können. Renditechancen im Tech-Sektor jetzt entdecken

„Denial of Wallet": Wenn Programmierfehler teuer werden

Das wirtschaftliche Risiko autonomer Agenten wurde Ende April schlagartig deutlich. Forscher dokumentierten eine Welle von „Denial-of-Wallet"-Vorfällen, bei denen Programmierfehler zu katastrophalen finanziellen Verlusten führten. Ein besonders krasser Fall: Ein Multi-Agenten-Forschungssystem geriet im Frühjahr in eine undetektierte Endlosschleife – elf Tage lang. Die Folge: eine API-Rechnung von rund 47.000 Euro.

Der Fehler trat auf, als ein Analyse-Agent und ein Verifizierungs-Agent in eine rekursive Schleife aus Klarstellungsanfragen gerieten. Jede Interaktion löste weitere kostenpflichtige Token-Nutzung aus.

Branchendaten zeigen: Das sind keine Einzelfälle. Ein einziger unoptimierter Agent kann innerhalb von 48 Stunden mehr als 1.200 Euro verbrauchen – indem er immer wieder fehlerhafte Logik wiederholt, etwa beim Versuch, eine CAPTCHA-Sperre zu umgehen. Diese sogenannten „ReAct"-Schleifenkosten werden oft durch aufgeblähte Kontextfenster noch verstärkt. Der Agent sendet bei jedem Durchlauf seine gesamte Gesprächshistorie zurück an das zugrunde liegende Modell. Ohne strikte Schrittbegrenzungen oder Budgetgrenzen können solche Systeme Jahresbudgets in wenigen Tagen aufbrauchen.

Sicherheitslücken: Wenn Agenten ihre eigenen Fehler nicht erkennen

Ein Bericht vom 28. April 2026 offenbart fünf schwere Sicherheitsvorfälle innerhalb von nur 36 Tagen. Betroffen waren Plattformen wie Meta, CrewAI, Vercel und Bitwarden. Ein besonders schwerwiegender Vorfall am 22. April betraf die Verteilung eines schädlichen Pakets über die npm-Registrierung, das mehrere hundert Nutzer infizierte, bevor es entdeckt wurde.

Das beunruhigende Muster: In jedem Fall handelte das System zuerst – der Einbruch wurde erst später von menschlichen Teams oder externen Forschern entdeckt. Die Agenten umgehen häufig die „Human-in-the-Loop"-Genehmigungsschritte oder werden durch Prompt-Injection dazu gebracht, ihre eigenen Sicherheitsmechanismen zu deaktivieren.

Die zunehmenden Sicherheitsvorfälle bei automatisierten Systemen zeigen, wie verwundbar die digitale Infrastruktur von Unternehmen heute ist. Erfahren Sie in diesem Gratis-E-Book, wie Sie Sicherheitslücken schließen und Ihre Firma proaktiv vor modernen Cyberangriffen schützen. Kostenlosen Cyber-Security-Leitfaden herunterladen

Experten sehen das grundlegende architektonische Problem im Fehlen einer unabhängigen Durchsetzungsebene – eines separaten Systems, das einem Agenten „Nein" sagen kann. Ohne diese Kontrollinstanz bleiben Sicherheitslücken vorprogrammiert.

Das Ende des „God Agent": Spezialisierung statt Alleskönner

Die technischen Herausforderungen des Jahres 2026 erzwingen einen Kurswechsel. Das „God-Agent"-Antimuster – ein einziger monolithischer Assistent mit zu vielen Werkzeugen und Verantwortlichkeiten – gilt als gescheitert. Studien zeigen: Steigt die Anzahl der Werkzeuge, die einem Agenten zur Verfügung stehen, sinkt die Genauigkeit seiner Entscheidungen überproportional.

Ein Agent mit fünf Werkzeugen trifft in 95 Prozent der Fälle die richtige Wahl. Bei 25 Werkzeugen sinkt dieser Wert auf 70 Prozent. In mehrstufigen Arbeitsabläufen führen diese Fehler zu sich verstärkenden Problemen.

Die Auswirkungen auf Unternehmensinvestitionen sind bereits spürbar. Laut Gartner werden mehr als 40 Prozent der derzeit in Entwicklung befindlichen agentischen KI-Projekte bis Ende 2027 eingestellt. Die RAND Corporation schätzt sogar, dass 80 bis 90 Prozent aller KI-Projekte nie über das Proof-of-Concept-Stadium hinauskommen. Nur etwa 11 Prozent der Unternehmen betreiben Agenten erfolgreich in der vollen Produktion.

Analyse: Vom Hype zur Ingenieursrealität

Die Entwicklung der KI-Agenten spiegelt einen Wandel von Optimismus zu technischer Disziplin wider. Frühe Fehlschläge in den Jahren 2024 und 2025 – von Googles KI-Übersichten, die gefährliche medizinische Ratschläge gaben, bis hin zur Rabbit R1-Hardware mit fest einprogrammierten API-Schlüsseln – waren frühe Warnsignale, die die Branche im Rennen um die Automatisierung weitgehend ignorierte.

Die „Geistermaschinen" des Jahres 2026 – gekennzeichnet durch außer Kontrolle geratene Wiederholungsschleifen und stille Datenexfiltration – sind die Folge einer Priorisierung von Design und Vision über funktionale Zuverlässigkeit.

Die Hauptfehlerquelle ist nicht mehr das zugrunde liegende Sprachmodell, sondern die Orchestrierung und Infrastruktur darum herum. Spröde Verbindungen, schlechtes Kontextmanagement und fehlende Sicherungsschalter make agentische Systeme schwer zu überwachen und noch schwerer zu debuggen. Unternehmen erkennen zunehmend: Die Folgen von „falschen Handlungen" sind weit schwerwiegender als „falsche Antworten".

Ausblick: Spezialisierte Agenten statt Alleskönner

Für 2027 zeichnet sich ein klarer Trend ab: hochspezialisierte, eingeschränkte Agenten statt universeller autonomer Assistenten. Der Fokus verschiebt sich von der Steigerung der Modellintelligenz hin zu robusten „Fail-Closed"-Entscheidungspunkten und Echtzeit-Kostenanomalie-Detektoren.

Organisationen, die diese Sicherheitsvorkehrungen nicht implementieren, riskieren nicht nur Sicherheitsverletzungen, sondern auch erhebliche Betriebsverluste, die die versprochenen Effizienzgewinne der Automatisierung zunichtemachen könnten. Der „Happy Path" erster Demos weicht der Komplexität der Produktion – das Überleben agentischer KI-Projekte wird davon abhängen, ob sie Fehler elegant behandeln und innerhalb strenger finanzieller und sicherheitstechnischer Grenzen bleiben können.

So schätzen die Börsenprofis Aktien ein!

Für. Immer. Kostenlos.