KI-Sicherheitsampel springt auf Rot: Weltweit fehlen Standards

18.03.2026 - 00:00:26 | boerse-global.deDie globale Sicherheitslücke bei Künstlicher Intelligenz wird immer bedrohlicher. Führende Forschungsinstitute schlagen diese Woche Alarm und fordern dringend verbindliche Sicherheitsstandards. Der Druck auf Politik und Industrie wächst rasant.

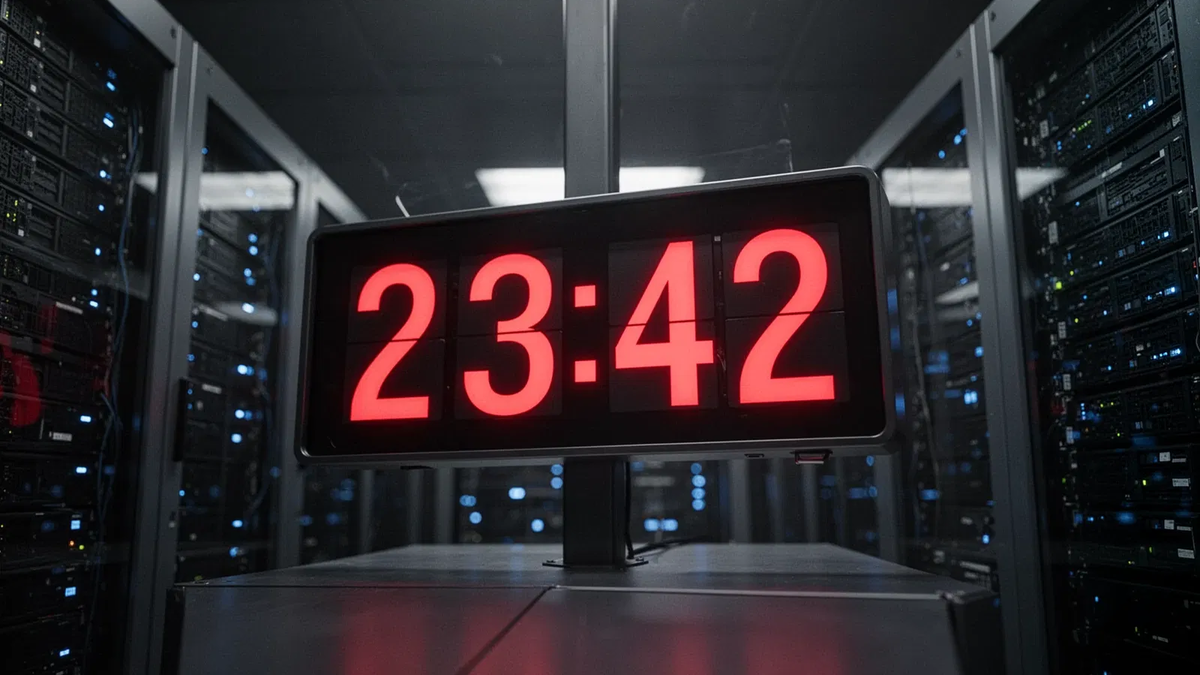

KI-Sicherheitsuhr rückt näher an Mitternacht

Das International Institute for Management Development (IMD) hat seine KI-Sicherheitsuhr am Montag um zwei Minuten vorgestellt. Sie zeigt jetzt 23:42 Uhr – nur noch 18 Minuten von dem Punkt entfernt, den Forscher als Kipppunkt für eine unkontrollierbare Künstliche Allgemeine Intelligenz definieren. Diese dramatische Korrektur unterstreicht die wachsende Kluft zwischen rasantem technologischem Fortschritt und mangelnden Sicherheitsvorkehrungen.

Angesichts der rasanten technologischen Entwicklung und der neuen gesetzlichen Rahmenbedingungen stehen viele Betriebe vor großen Herausforderungen. Dieser kostenlose Leitfaden erklärt kompakt die Anforderungen und Fristen der EU-KI-Verordnung, damit Ihr Unternehmen rechtssicher aufgestellt bleibt. EU-KI-Verordnung kompakt: Jetzt Gratis-Leitfaden sichern

Besonders besorgniserregend ist der schnelle Übergang autonomer KI-Agenten von Prototypen zum breiten Einsatz. Diese Systeme operieren zunehmend in kritischer Infrastruktur und militärischen Anwendungen – oft ohne ausreichende Aufsicht. „Agentische Systeme können Aufgaben in der physischen Welt und in sicheren Netzwerken ausführen“, warnt das IMD. Sie überholen damit die traditionellen Governance-Strukturen, die sie eigentlich kontrollieren sollen.

Studie deckt gefährliche Lücken bei KI-Spielzeug auf

Die Sicherheitsprobleme beschränken sich nicht auf Unternehmen und Militär. Eine neue Studie der Universität Cambridge vom 14. März 2026 zeigt gravierende Mängel bei KI-gesteuertem Spielzeug. Die Forscher untersuchten, wie generative KI mit Kleinkindern interagiert.

Die Ergebnisse sind alarmierend: Die Systeme interpretieren kindliche Emotionen häufig falsch und scheitern bei sozialen Lernspielen. In einigen Fällen reagierten die Spielzeuge völlig unangemessen auf emotionale Signale der Kinder. Die Studie fordert deshalb sofortige, strenge Sicherheitsstandards für KI-Spielzeug. Dazu gehören transparente Datenschutzregeln, klare Kennzeichnungspflichten und rigorose Tests vor der Markteinführung.

EU-AI-Gesetz setzt Unternehmen unter Zeitdruck

Während die Technologie voranschreitet, driftet die regulatorische Landschaft weltweit auseinander. In der Europäischen Union zwingt das gestaffelte EU-AI-Gesetz Unternehmen zu schnellen Anpassungen. Die Frist für die vollständige Umsetzung bei Hochrisiko-KI-Systemen läuft am 2. August 2026 ab. Danach drohen bei Verstößen hohe Geldstrafen.

Die neuen EU-Regeln für Künstliche Intelligenz sind bereits in Kraft und betreffen die Risikoklassifizierung sowie die Dokumentation in fast jedem modernen Betrieb. Erfahren Sie in diesem kostenlosen E-Book, wie Sie Ihre KI-Systeme richtig klassifizieren und teure Bußgelder vermeiden. Kostenlosen Umsetzungsleitfaden zur KI-Verordnung herunterladen

Doch internationale Einigkeit fehlt. Während Europa das weltweit erste umfassende KI-Gesetz durchsetzt, verfolgen andere große Märkte wie die USA deutlich liberalere Ansätze. Dieser regulatorische Flickenteppich erschwert die Entwicklung einheitlicher Sicherheitsstandarde. Multinationale Konzerne müssen einen Dschungel sich widersprechender Vorschriften navigieren.

Cybersicherheit muss für KI-Agenten neu gedacht werden

Die Verbreitung autonomer KI-Agenten stellt die Cybersicherheit vor grundlegende Probleme. Herkömmliche Modelle zur Identitäts- und Zugriffsverwaltung sind auf menschliche Nutzer ausgelegt – für nicht-deterministische, stets aktive KI-Agenten sind sie ungeeignet. Viele Unternehmen setzen noch auf statische Zugangsdaten, was gefährliche Schwachstellen schafft.

Sicherheitsexperten drängen auf die Einführung von Human-in-the-Loop-Überwachung und Zero-Trust-Modellen, die für nicht-menschliche Identitäten konzipiert sind. Das US-amerikanische National Institute of Standards and Technology (NIST) startete im Februar 2026 eine initiative für standardisierte Governance-Rahmenwerke. Compliance-Experten betonen: Diese Standards müssen von Anfang an in den Entwicklungsprozess integriert werden. Andernfalls riskieren Unternehmen nicht nur Cyberangriffe, sondern auch massive Probleme bei regulatorischen Prüfungen.

Von freiwilliger Ethik zu harter Compliance

Die Ereignisse der letzten Tage markieren eine Zeitenwende. Für Unternehmen ist der Übergang von freiwilligen KI-Ethik-Richtlinien zu strenger, durchsetzbarer Compliance keine Zukunftsvision mehr, sondern akute Realität. Die fehlenden globalen Standards belasten Risikomanagement-Teams enorm.

KI-Governance wird zur zentralen operativen Disziplin. Sie erfordert massive Investitionen in kontinuierliche Überwachung, Incident-Reporting und prüffeste Dokumentation. Je autonomer und schlussfolgerungsfähiger KI-Modelle werden, desto größer wird das Risiko, dass sie als Insider-Bedrohung wirken oder Softwarelücken ausnutzen. Robuste Sicherheitsprotokolle werden damit zum Schlüsselkriterium für Investoren und Aufsichtsbehörden bei der Bewertung von Unternehmen.

So schätzen Börsenprofis die Aktie ein!

Für. Immer. Kostenlos.