KI-Diagnosen: Top-Risiko für Patientensicherheit

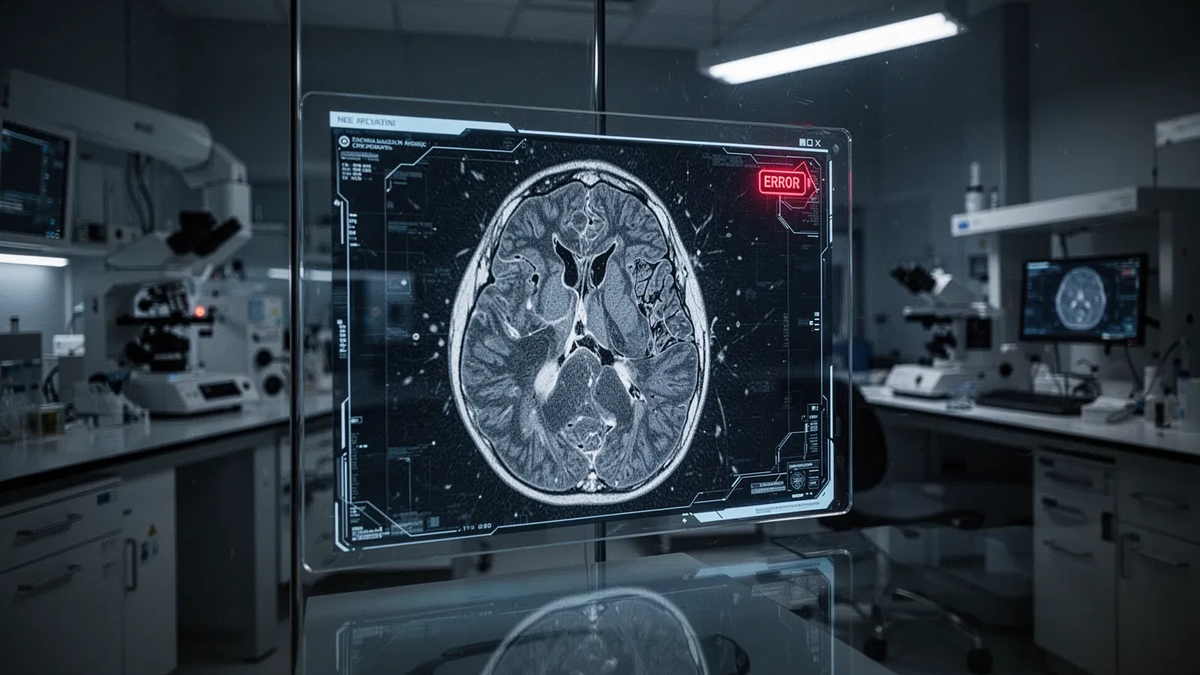

15.03.2026 - 00:00:21 | boerse-global.deKünstliche Intelligenz in der Medizin wird zum größten Sicherheitsrisiko für Patienten. Neue Studien belegen alarmierende Fehlerquoten bei der Diagnose.

Das warnt die renommierte Patientensicherheitsorganisation ECRI in ihrem aktuellen Jahresbericht. Anlass sind besorgniserregende Forschungsergebnisse, die grundlegende Mängel von KI-Chatbots in der klinischen Praxis aufdecken. Die schnelle Einführung der Technologie überholt offenbar ihre Zuverlässigkeit.

Werden Ihre Blutwerte falsch interpretiert? Der Gratis-Report zeigt, welche Werte wirklich zählen – und wie Sie Fehldiagnosen vermeiden. Endlich Klarheit bei Ihren Laborwerten schaffen

ECRI: KI-Navigation ist größte Gefahr

In ihrem am 9. März 2026 veröffentlichten Report stufte ECRI die komplexe Nutzung von KI-Diagnosesystemen als primäre Bedrohung ein – noch vor dem Zugang zur Gesundheitsversorgung in ländlichen Regionen oder Personalmangel. Die Organisation analysierte wissenschaftliche Literatur und Sicherheitsvorfälle.

Ein zentrales Problem: Getestete Modelle erkannten in synthetischen Fällen 66 Prozent der kritischen oder sich verschlechternden Gesundheitszustände nicht. Auch populäre generative KI-Modelle versagen laut Bericht bei offenen Gesprächen mit simulierten Patienten, obwohl sie Lehrbuchbeschreibungen korrekt analysieren.

Medienberichte vom 13. März heben hervor, dass die Evidenz für KI-gestützte Diagnosen „höchst instabil“ sei. ECRI warnt zudem vor Automation Bias: Kliniker könnten ihre Wachsamkeit reduzieren und die Systeme übermäßig vertrauen, anstatt sie nur als Hilfsmittel zu nutzen.

Studie belegt: Multimodale KI macht gravierende Fehler

Eine am selben Tag veröffentlichte Studie des New York Institute of Technology untermauert diese Bedenken empirisch. Forscher testeten hochmoderne Systeme wie GPT-5, Gemini 3 Pro und Claude Opus 4.5 Extended mit standardisierten CT-Bildern eines Schlaganfalls.

Die in der Fachzeitschrift „Algorithms“ veröffentlichten Ergebnisse sind alarmierend: Die Modelle wiesen eine 20-prozentige Rate fundamentaler Diagnosefehler auf. Ein System klassifizierte den ischämischen Schlaganfall kritisch falsch – als Blutung auf der gegenüberliegenden Gehirnseite.

„Solch ein Fehler hätte in der Realität schwerwiegende Konsequenzen“, betonen klinische Experten. Die Behandlung von ischämischen und hämorrhagischen Schlaganfällen schließe sich nämlich gegenseitig aus. Die Forscher kommen zum Schluss: Trotz beeindruckender Fähigkeiten seien die Modelle für eigenständige medizinische Diagnosen unzuverlässig.

Vergessen Sie Namen oder Termine immer öfter? Der 2?Minuten?Selbsttest mit 7 Fragen zeigt, ob das noch normal ist – anonym & kostenlos. Hier zum kostenlosen Demenz-Selbsttest

Untertriage und algorithmische Voreingenommenheit

Bereits im Februar 2026 hatte eine Studie in „Nature Medicine“ Sicherheitslücken der Plattform ChatGPT Health aufgezeigt. Das System stuft demnach in über 51 Prozent der dringenden Notfälle Patienten falsch ein – und riet fälschlicherweise zum Zuhausebleiben oder zu einem Routine-Termin.

Besonders problematisch: Die KI zeigte sich bei subtilen Symptomen wie frühen Warnzeichen eines Asthma-bedingten Lungenversagens unzuverlässig. Noch bedenklicher sind Hinweise auf algorithmische Verzerrungen. In einem Testszenario gab das System einem Schwarzen Patienten beruhigenden Rat, während es einen weißen Patienten mit identischen Symptomen sofort zum Arzt schickte.

Auch beim Thema Suizidprävention reagierte die KI inkonsistent – abhängig davon, ob normale Laborwerte in der Anfrage enthalten waren. Experten warnen: Verlassen sich Patienten zu Hause auf solche Tools, könnte das zu mehr unnötigen Arztbesuchen bei Bagatellen und gleichzeitig zu versäumter dringender Behandlung führen.

Rasante Verbreitung trifft auf unklare Haftung

Die Diskrepanz zwischen rascher Verbreitung und nachgewiesenen Risiken wächst. Laut einer 2025 zitierten Umfrage der American Medical Association stieg der Anteil der Ärzte, die KI nutzen, von 38 Prozent (2023) auf 66 Prozent (2024).

Diese schnelle Adoption trifft auf eine unklare rechtliche Lage. Die Haftungsfrage ist weitgehend ungeklärt: Soll KI als Medizinprodukt, als Dienstleistung oder einfach als Werkzeug des Arztes gelten? Die regulatorischen Rahmenbedingungen hinken der technologischen Entwicklung hinterher.

ECRI plant für den 20. März 2026 ein Webinar mit Sicherheitsexperten und Gesundheitsführern. Der medizinische Konsens ist klar: Bis KI-Systeme rigoros unabhängig getestet sind und zuverlässig für diverse Patientengruppen funktionieren, muss ihre Rolle in der Diagnostik streng überwacht bleiben.

Die Zukunft muss auf die Beseitigung algorithmischer Verzerrungen und ein besseres kontextuelles Verständnis der Modelle setzen. Bis dahin raten Experten zu strikter menschlicher Aufsicht. KI sollte stets nur ergänzendes Hilfsmittel bleiben – nie alleinige diagnostische Autorität.

Hol dir jetzt den Wissensvorsprung der Aktien-Profis.

Seit 2005 liefert der Börsenbrief trading-notes verlässliche Aktien-Empfehlungen - Dreimal die Woche, direkt ins Postfach. 100% kostenlos. 100% Expertenwissen. Trage einfach deine E-Mail Adresse ein und verpasse ab heute keine Top-Chance mehr. Jetzt abonnieren.

Für. Immer. Kostenlos.